Creare spazi virtuali per lo spettacolo dove potersi esibire a distanza è possibile grazie alla realtà aumentata. Ora, attraverso nuove tecnologie e un po’ di programmazione, gli artisti dello spettacolo possono non solo animare personaggi fantastici ma anche performare in un una scenografia di qualità.

Nella realtà aumentata vengono ricreati digitalmente dei paesaggi e delle scenografie che è poi possibile abitare in veste di personaggi di fantasia. Abbiamo visto le potenzialità della realtà aumentata nei videogame e nel cinema, ma con l’uscita sul mercato di nuove tute e sensori indossabili, catturare i movimenti complessi è diventato sempre più facile e più accessibile a progetti piccoli e indipendenti.

Per permettere una comunicazione creativa tra il nostro corpo e lo schermo di un computer, non saranno necessari solo i sensori. Sarà infatti imprescindibile una collaborazione tra i professionisti dello spettacolo e i professionisti della grafica digitale come videogame designer, programmatori e artisti digitali. Utilizzando i dati provenienti dai sensori, i performer potranno assumere le sembianze di un avatar, ideato dal designer, per interagire con un paesaggio virtuale e dar vita a una sceneggiatura.

Che cos’è un avatar

Nel mondo moderno, un avatar è un personaggio che ci rappresenta online. Esso può avere il nostro nome, può dire le cose che scriviamo e può assomigliarci, oppure può essere un soggetto completamente diverso. Nei videogame di ruolo, ci si avvicina molto l’idea originale di avatar. Con l’impressione di comandare un personaggio fantastico dalle capacità sovrumane, i videogame permettono, a chi gioca, di compiere imprese straordinarie.

Nell‘induismo, la parola avatar ha preso vita per la prima volta. Un avatar è una personalità che ha la capacità di portare Dio a tutte le persone sulla terra. In realtà un avatar, è Dio stesso che però ha preso sembianze umane, ma non mangia, non dorme e vive al di là delle leggi di natura. Vivendo in uno spazio “virtuale” che differisce dalla realtà conosciuta, gli avatar possono apparire in diversi posti contemporaneamente e animare diversi corpi di volta in volta. Onnisciente e onnipotente, l’avatar è un mago divino, conosciuto per i suoi miracoli.

Mentre nei videogame siamo abituati a muovere il nostro avatar attraverso un controller remoto, nei film moltissimi attori sono stati trasformati in creature straordinarie attraverso la tecnologia della motion capture. Con le nuove tute sensoristiche sarà possibile costruire un ponte fra queste due arti.

Potendo animare una creatura virtuale, a partire dai propri movimenti corporei, si diventare direttamente attivi nella storia, con le proprie capacità. Grazie a i sensori indossabili, è anche possibile interagire con lo spazio virtuale progettato sul computer, e creare, all’interno di esso, delle storie per il nostro avatar.

Come creare spazi virtuali per lo spettacolo

Per iniziare bisogna che un designer crei dei personaggi 3D in un software di modellazione. Il file poi viene esportato nei formati standard come .FBX (Filmbox) e .giTF ( Graphics Language Transmission Format), su un motore di simulazione ( come Unreal Engine) dove verrà costruito lo spazio virtuale in cui i personaggi si muovono. Si potrà poi performare live, indossando una tuta tecnologica che rispecchierà i nostri movimenti sull’avatar caricato nel programma di render.

Le novità tecnologiche degli ultimi anni hanno allargato molto il target della motion capture, un tempo estremamente esclusiva ed utilizzata solamente per grandi progetti come film di animazione e saghe di videogame. Il ribasso del prezzo della tuta (prima intorno ai 100.000 dollari) dipende soprattutto dall’arrivo di marcatori visivi passivi (da pochi dollari) e dall’arrivo di una tecnologia Wifi indossabile.

Alcune tute sul mercato

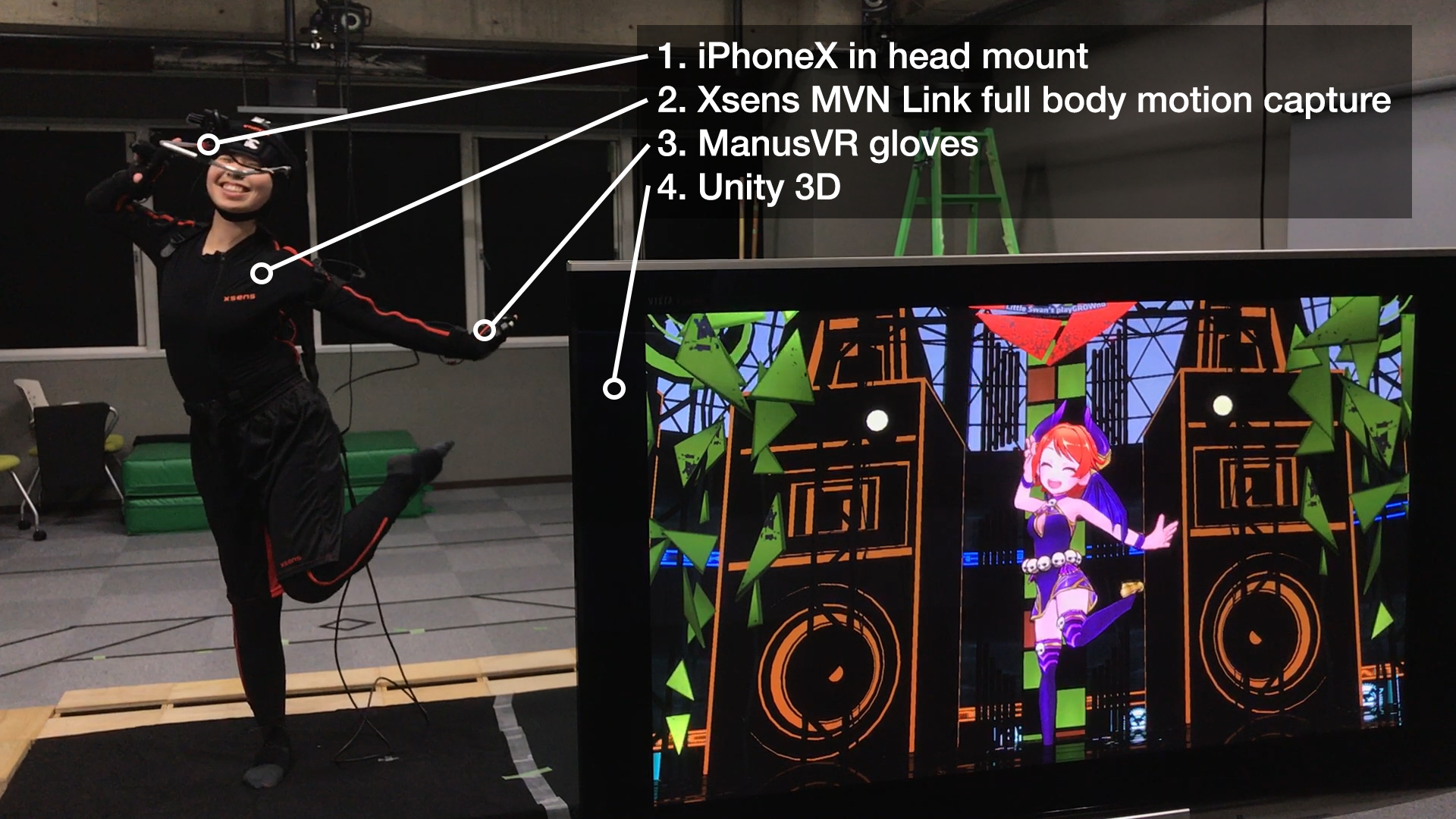

Per la danza viene consigliata la Xsens Link ed il suo software MVN. Sebbene costi 12.000 dollari, questa tuta è la più economica tra le tute di livello superiore. Per iniziare ad utilizzarla non servono ulteriori attrezzature esterne perché la tuta è alimentata a batteria e trasmette i dati al computer attraverso il Wifi. La tuta può essere utilizzata anche all’aperto, non è sensibile al magnetismo, così come non sono necessari altri sensori esterni per il tracking.

La Xsens Link è stata utilizzata dall’ artista cinese LU YANG, che ha creato un spazio virtuale chiamato Digital Reincarnation in cui ha invitato a collaborare performer di ogni genere.

In questo spazio, l’artista vuole poter creare un mondo di infinite possibilità che, grazie alla motion tracking, possono avvenire in tempo reale. Reincarnati in dei veri e propri avatar psichedelici, i danzatori si esibiscono in un’esperienza tribale e diabolica. Grazie alla capacità di ripresa di 240 frame al secondo, i movimenti appaiono fluidi e dinamici. La prospettiva nel video invece cambia in base a dove il ballerino guarda mentre si muove nello spazio. Quella di LANG è un’esperienza estetica per dimostrare la bellezza imprevedibile nata dall’incontro tra tecnologia e danze tradizionali.

Un’altra tuta che sembra essere ancora più economica è la Perception Neuron PRO che invece costa solamente 3.500 dollari. I sensori della Neuron vengono venduti in una valigetta e possono essere posizionati sul corpo tramite degli strappi regolabili. Anche questa tuta resiste ai campi magnetici e può essere utilizzata all’esterno.

La tuta è stata ampliamente utilizzata per progetti creativi indipendenti, visto il suo prezzo ridotto. Sul sito ufficiale vengono offerti numerosi pacchetti che arrivano a un prezzo massimo di 6.400 dollari, con cui è possibile ottenere 2 tute. La Perception Neuron PRO controlla fino a 17 sensori, i cui dati vengono registrati sul software AXIS NEURON PRO. La calibrazione e il set-up richiede circa 5 minuti.

Anti-gone e la narrativa tra mondo virtuale e reale

La NEURON PRO è stata utilizzata nel pluripremiato spettacolo virtuale Anti-gone che, dopo aver terminato il suo tour digitale del 2020, sarà in mostra al Biodigital Teathre del Sundance Institute. L’opera virtuale dell’artista greco Theo Triantafyllidis, racconta la storia di due avatar in un mondo futuro, dopo il cambiamento climatico, dove la catastrofe ambientale è ormai normalizzata. Le città sono affondate ma esiste ancora la civilizzazione. Spyda and Lynxa sono gli avatar protagonisti della storia, e navigano questo mondo intrattenendosi con diverse attività dallo shopping alle droghe psichedeliche. La performance di Anti-gone, ha dimostrato un aspetto molto importante del rapporto fra spettacolo e tecnologia.

Gli attori che animavano la storia, non erano solamente forniti di una tuta ma avevano con sé anche oggetti di scena e una scenografia. Se nello schermo vedevamo uno degli avatar agire solo minimamente, era perchè l’attore sul palco si fermava a fare un’azione statica, come leggere un libro. La conversazione tra attore e avatar, tra reale e virtuale, è stata, con Anti-gone, arricchita di significato. Proprio perché, sia uno che l’altro, hanno seguito due storie a volte coincidenti a volte diverse e quindi hanno creato una complessità narrativa superiore, che è il vero contributo della realtà aumentata al mondo dello spettacolo.

Ulteriori opzioni sul mercato

Questi progetti indipendenti, hanno potuto usufruire delle nuove tute per la motion capture, grazie ai prezzi ridotti e agli sviluppi dell’interfaccia utente. Sarebbe comunque ideale dotarsi di questi sistemi a un livello di produzione teatrale. Alcuni propongono addirittura di affittare, visto che i tempi di utilizzo della tuta si limitano al momento della calibrazione e al momento dello spettacolo.

Per chi volesse sperimentare ora e creare il proprio avatar virtuale per una video call creativa invece, Hyprsense ha sviluppato una tecnologia di mappatura tramite la telecamera del cellulare. Si chiama Hyprface, un App (ora disponibile in versione Demo sia per IOS che per Android) che può essere utilizzata per tracciare le espressioni facciali dal vivo e ricostruirle dentro un avatar 3D a nostra scelta.

Elisa Melodia